Prof. Olko: Punkty nie zastąpią strategii naukowej państwa

Od dłuższego czasu tkwimy w bezproduktywnej i wypalającej środowisko dyskusji na temat systemu ewaluacji jednostek naukowych w Polsce, która coraz bardziej zdaje się nie prowadzić nigdzie indziej niż do dalszego utrwalenia obecnego systemu. Próby jego naprawy, poprawy i doskonalenia spotykają się z żywym odbiorem środowiska, budząc – często antagonizujące – dyskusje. Nic dziwnego. W mojej opinii tego systemu nie da się poprawić, udoskonalić czy zaktualizować.

Nie ma jasności, a przynajmniej jasno komunikowanej, spójnej, a zarazem szerszej wizji, jaki cel miałby taki system spełniać poza nadawaniem dość abstrakcyjnych kategorii o mocno ograniczonej funkcjonalności. Brakuje również – po stronie decydentów politycznych – powiązania systemu ewaluacji z krótko- i długofalową polityką naukową państwa oraz strategicznymi celami stawianymi badaniom w Polsce. Ciężko również o powiązanie ewaluacji ze strategią rozwoju jednostek naukowych – muszą zupełnie bezproduktywnie alokować ogromne zasoby czasowe i ludzkie w system oceny, na którego kształt mają ograniczony lub żaden wpływ (może z wyjątkiem ręcznego sterowania punktacją czasopism). Nie wydaje mi się również, aby obecny system ewaluacji pozwalał na jasną i rzetelną diagnozę oraz mapowanie obszarów doskonałości, a zarazem wychwycenie specyficznych problemów uniemożliwiających, na konkretnych polach i w określonych środowiskach, podążanie za czołówką nauki światowej.

Nie ukrywam, że najbliższa mi wizja systemu ewaluacji nauki ma niewiele wspólnego z tą, w której od długiego czasu tkwimy: powstała ona w 2024 r. w zespole powołanym przez Prezesa PAN. Wypracowana w nim propozycja systemu oceny i związanych z nim zasad dystrybucji środków finansowych jest relatywnie prosta i mało podatna na manipulacje. Pozwala na dostrzeżenie i docenienie najlepszych osiągnięć przy rezygnacji z presji na „urobek” naukowy; ma zachęcać jednostki do podnoszenia jakości badań oraz do zatrudniania najlepszych naukowców.

Mam świadomość, jak ciężko przekonać do niej środowisko, mimo prostoty i transparentności zaproponowanego systemu ramowego. Paradoksalnie, mimo że poziom poczucia bezsensu i zmęczenia mechanicznym stosowaniem wskaźników bibliometrycznych jest wysoki, środowisko nie jest gotowe, aby z nich zrezygnować. Może dlatego, że to opcja, która nas najwyraźniej skolonizowała, mimo że ekspercki system oceny (peer review) udało się wdrożyć, lepiej lub gorzej, w tak wielu płaszczyznach funkcjonowania nauki. Nie ma powodów, aby sądzić, że ten – najlepszy, jaki dotąd wynaleziono – paradygmat nie sprawdził się również w eksperckiej ocenie środowiskowej.

Przy czym szczegóły tego rozwiązania są mniej istotne na tym etapie dyskusji niż sama zgoda na zmianę paradygmatu. Decyzja, czy pełna ocena ekspercka miałaby objąć wszystkie jednostki, czy tylko najlepsze, i jak zdefiniować linię podziału, jest możliwa do podjęcia nawet w oparciu o obecnie dostępne, niedoskonałe dane o kondycji polskiej nauki. Taki podział w jakimś sensie wdrożył częściowo przynajmniej ministerialny program IDUB, który nie budzi podobnych kontrowersji jak na przykład to, czy publikowanie po angielsku narusza strategiczne cele polskiej nauki, zwłaszcza w humanistyce i naukach społecznych.

Jako konsekwentna realizatorka podejścia, że język i miejsce publikacji są determinowane przez grupę odbiorców, do których świadomie chcemy dotrzeć, a różne strategie publikacyjne się nie tylko nie wykluczają, ale wzajemnie wzmacniają, uważam, że ta bezproduktywna dyskusja tylko odciąga nas od kwestii o wiele bardziej fundamentalnych. Jest dla mnie jednak jasne, że celem nauki uprawianej w Polsce, niezależnie od dziedziny, jest znaczące poszerzanie granic wiedzy, tak w relacji do potrzeb lokalnych, jak i globalnych, oraz w ścisłej relacji do standardów i wyzwań stawianych przez wiodącą naukę światową, której powinniśmy być niekwestionowaną częścią. Wtedy będziemy mieć więcej do zaoferowania także na poziomie krajowym. System ewaluacji powiązany z polityką naukową państwa powinien takie cele strategiczne wspierać.

Ręcznie sterowany system punktacji czasopism, ustalany z nieuwzględnieniem fundamentalnych zasad konfliktu interesów proponentów, tych dążeń w mojej opinii nie wspiera. Nie wspiera ich również anachroniczna ewaluacja w dyscyplinach, ograniczająca rozwój naukowy zarówno indywidualnych badaczy, jak i jednostek, oraz będąca źródłem potencjalnych patologii. Prowadzi ona często do podporządkowywania działań organizacyjnych i strategii badawczych interesom określonej dyscypliny, a przede wszystkim, co chyba najbardziej szkodliwe – do myślenia naukowego przez pryzmat dyscyplin z pominięciem relacyjności i kierunków rozwoju nauki światowej. Oczywiście wtórnie obchodzimy ten system, dopasowując ręcznie interdyscyplinarne publikacje do slotów monodyscyplinarnych, wedle luk i potrzeb danej dyscypliny w jednostce. Można to oczywiście dalej robić, tylko po co?

I wreszcie wpływ. Czy obecny system pozwala rzeczywiście wychwycić i zmierzyć impakt naukowy, mimo przywiązania do mierzalnych wartości? Trzeci obszar ewaluacji ma ambitne zadanie oceny wpływu społecznego. Problem polega jednak na tym, że generowanie impaktu nie jest wbudowane systemowo w zarządzanie nauką, w jej finansowanie i w działalność jednostek naukowych, a sam impakt nie jest wystarczająco dobrze skonceptualizowany i powiązany z akademicką „kulturą wpływu”.

Obecny system zakłada niejako, że impakt powinien się pojawić niejako „na marginesie” naszych badań, a następnie, co cztery lata, na tymże marginesie należy gorączkowo udokumentować ów wpływ i przedstawić poważne dowody jego zaistnienia. Tymczasem impakt można zmierzyć jedynie w odniesieniu do konkretnych zmian poza akademią wygenerowanych przez prowadzone z jej udziałem badania. A zmierzenie i udokumentowanie takiego wpływu to zwykle osobny projekt naukowy wymagający długofalowego finansowania i czasu realizacji.

Czasem – choć rzadko i z trudem (lub, co gorsza, nieformalnie!) – udaje się wbudować działania obliczone na wpływ społeczny oraz włączyć ich monitoring w konkretne projekty czy programy. Tymczasem wytwarzanie impaktu powinno być integralną częścią systemu organizacji nauki i kultury akademickiej, w ścisłym powiązaniu z paradygmatami systemu ewaluacji i z polityką naukową państwa.

Przykładem takiej konceptualizacji generowania wpływu mogą być na przykład zasady SCOPE. Zgodnie z nimi ewaluacja powinna być dokonywana tylko wtedy, gdy to niezbędne, i z oceną relacji zysków z niej płynących do kosztów jej przeprowadzenia; w jej kształt oraz interpretację wyników powinni być także zaangażowani przedstawiciele ocenianego środowiska. Co więcej, ewaluacja winna także podlegać ewaluacji. W skrócie, wielowymiarowy wpływ badań powinien być częścią kultury organizacyjnej jednostek i systemowo powiązany z zasadami ewaluacji w trakcie całego procesu jego generowania, a zarazem z aktualną polityką naukową w Polsce. Pod warunkiem oczywiście, że zostanie ona sformułowana.

Polecane:

-

Artykuł

Nauka dla przyszłości. Nowa strategia rozwoju polskiej nauki Przejdź do publikacji: Nauka dla przyszłości. Nowa strategia rozwoju polskiej nauki

-

Artykuł

Prof. Siuda: Humanistyka nie kończy się na granicy państwa Przejdź do publikacji: Prof. Siuda: Humanistyka nie kończy się na granicy państwa

-

Artykuł

Prof. Jemielniak o habilitacji: Obrona europejskiego standardu przed polską kulturą narzekania Przejdź do publikacji: Prof. Jemielniak o habilitacji: Obrona europejskiego standardu przed polską kulturą narzekania

Podobne artykuły

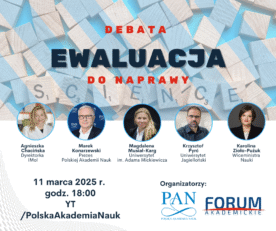

Przejdź do publikacji: Ewaluacja do naprawy - debata

Przejdź do publikacji: Ewaluacja do naprawy - debata

Ewaluacja do naprawy – debata Przejdź do publikacji: Ewaluacja do naprawy - debata

Przejdź do publikacji: Prof. Agata Starosta o polityce bez wiedzy o nauce

Przejdź do publikacji: Prof. Agata Starosta o polityce bez wiedzy o nauce

Prof. Agata Starosta o polityce bez wiedzy o nauce Przejdź do publikacji: Prof. Agata Starosta o polityce bez wiedzy o nauce

Przejdź do publikacji: Punkty, których nie ma w systemie. O nauce, której nie da się policzyć

Przejdź do publikacji: Punkty, których nie ma w systemie. O nauce, której nie da się policzyć