Historyczna ewolucja poglądów o wpływie technologii na pracę.

Gatunek ludzki, a mówiąc językiem biologii ewolucyjnej, Homo sapiens, pojawił się na Ziemi około 300 tys. lat temu. Jednakże przez sporą część naszego istnienia nic nie wskazywało na to, że o to w ciągu paru tysięcy lat rozwiniemy zaawansowaną cywilizację, wylądujemy na księżycu czy wymyślimy TikToka.

A przecież używanie rozmaitych może jeszcze nie maszyn, ale już narzędzi było nieodłączną cechą naszego gatunku. Na bardziej zaawansowane maszyny, niekiedy wyprzedzające swoje czasy o całe wieki, przyszło ludzkości czekać aż do czasów starożytnych. Zarazem rozwój technologiczny czy cywilizacyjny nigdy nie przebiegał liniowo, lecz bardziej na zasadzie przełomów albo wręcz niekiedy dość gwałtownych rewolucji. Istotny wpływ miała tu także ogólnie sytuacja ekonomiczna czy społeczna, np. dzięki bardziej wydajnemu rolnictwu powstawał naddatek ludzi mogących pracować w rodzącym się przemyśle. Pierwsza historycznie oficjalna rewolucja przemysłowa to już czasy nowożytne – mowa tu bowiem o przełomie XVIII i XIX wieku w Wielkiej Brytanii. To właśnie wtedy na przemysłową skalę zastosowano maszynę parową, co umożliwiło rozwój wielu gałęzi przemysłu, zwłaszcza włókienniczego. Wraz z powstającymi fabrykami i maszynami rodziły się pytania o przyszłość pracy i rolę pracowników. Tytułowa „kwestia maszyn” to problem poruszony już w 1817 roku przez ekonomistę Davida Ricardo, który pisał tak:

„Jeżeli przy zatrudnianiu tej samej ilości pracy, liczba pończoch dzięki ulepszonej maszynie wzrasta w czwórnasób, popyt zaś na nie podwaja się tylko, to pewna liczba robotników traci zajęcie w pończosznictwie”.

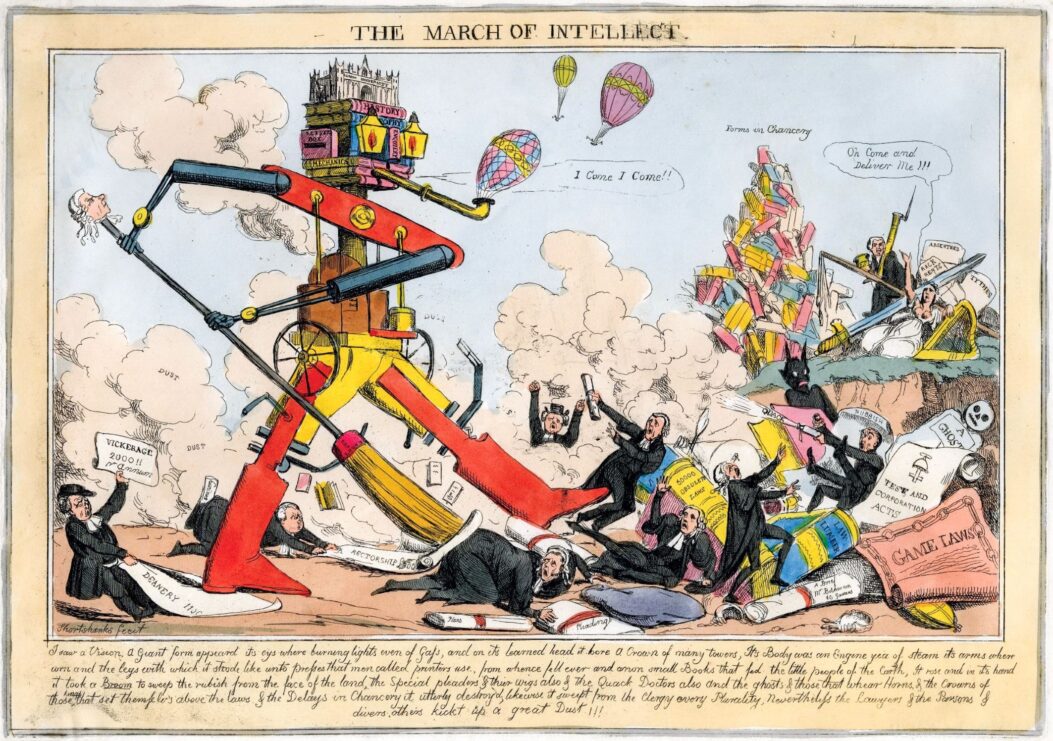

Choć powyższy przykład może brzmieć cokolwiek niewspółcześnie, a Ricardo zapewne nie słyszał o marketingu czy generowaniu popytu, to w jego słowach dają się wyraźnie dostrzec obawy przed automatyzacją (nawet jeśli nie używano wtedy tego słowa) czy po prostu przed byciem zastąpionym przez maszyny albo zostaniem „człowiekiem zbędnym”. Rewolucja przemysłowa przyniosła też wiele zmian w ówczesnym społeczeństwie brytyjskim, np. stawiano większy nacisk na upowszechnienie wiedzy naukowej, zwłaszcza z nauk przyrodniczych – zjawisko to, nazwane Marszem Intelektu, stanowiło zarazem przedmiot gorących dyskusji. Klimat i wyobraźnię tamtych czasów dobrze oddaje rysunek Roberta Seymoura z 1828 roku przedstawiający coś na wzór humanoidalnego robota na parę wymiatającego wielką miotłą wszelkiej maści zapóźnione ustawy parlamentarne, sprawy sądowe czy też szarlatanów.

ROBERT SEYMOUR, C.1828 © TRUSTEES OF THE BRITISH MUSEUM (CC BY-NC-SA 4.0)

To już było

Intensywny rozwój narzędzi sztucznej inteligencji (SI), a zwłaszcza tej generatywnej, którego doświadczamy od końca 2022 roku spowodował nasilenie się narracji, które brzmią łudząco podobnie do tych XIX-wiecznych – także dziś toczy się analogiczna debata o charakterze postępu, który SI miałaby przynieść w nauce czy całemu społeczeństwu. Jednocześnie intensywnie dyskutuje się o jej wpływie na pracę czy nawet na całe gospodarki – mówi się wręcz o kolejnej rewolucji, wzorem tej industrialnej. Pośród licznych doniesień medialnych o SI dominują te o hipotetycznej masowej automatyzacji wielu stanowisk.

Pewien raport przewidywał, iż SI może zastąpić równowartość 300 mln miejsc pracy na świecie, zarazem przyczyniając się do wzrostu produktywności czy tworząc wręcz nowe miejsca pracy.

Wielu pracowników martwi się o swoją przyszłość, rozważając zmianę zawodu na mniej zagrożony automatyzacją. Nie brak też kasandrycznych głosów, jakoby wysoce rozwinięta SI miała się kiedyś wymknąć spod kontroli czy zbuntować, sprowadzając na ludzkość nieszczęścia lub wręcz zagładę. Wszystko to już było co najmniej od XIX wieku, a niekiedy i znacznie dłużej. Choć obecnie obserwujemy kolejną już odsłonę „kwestii maszyn”, nie znaczy to jednak, że kwestia ta jest już (czy na dobrą sprawę kiedykolwiek była) rozwiązana. Trzeba stwierdzić, że w zasadzie od zawsze protestowano przeciw jakimikolwiek nowym technologiom, np. przeciw budowie pierwszych linii kolejowych, po których pociągi poruszały się i tak z niewielką prędkością. W latach 60. XX wieku nauczyciele protestowali przeciwko używaniu kalkulatorów w szkołach. Wtedy też zresztą zaczęły upowszechniać się bardziej zaawansowane kalkulatory, tj. komputery, co do których obawiano się, że pozbawią pracy rzesze pracowników. Faktem jest jednak, iż do masowego technologicznego bezrobocia nigdy nie doszło – owszem, wiele zawodów zniknęło, ale na ich miejsce pojawiały się nowe. Co więcej, już prawie 100 lat temu ekonomista John Maynard Keynes zakładał, iż rozwój technologii może skrócić tydzień pracy do 15 godzin – to, jak wiemy, również się nie sprawdziło, a możemy mieć odwrotne wrażenie – mimo rozwoju technologii pracujemy dłużej. Choć dziś również nie brakuje argumentów, że tak jak dekady temu niesłusznie obawiano się kalkulatorów w szkołach czy „bezrobocia komputerowego”, tak teraz niesłusznie obawiamy się SI (zwłaszcza generatywnej) czy w to szkołach, czy w pracy – tym razem dyskusja ma jednak cokolwiek inny charakter, albowiem technologia i tak odgrywa już dominującą rolę w wielu sferach życia, a ponadto jest wytwarzana zupełnie inaczej, niż działo się to wcześniej. Co bardziej optymistyczni zwolennicy technologii argumentują, że ma tu po prostu miejsce niezaprzeczalny, liniowy, a czasem wręcz skokowy progres – od maszyny parowej, przez elektryczność, po urządzenia cyfrowe – a SI, ta hipotetyczna, rzekomo bardzo zaawansowana czy wręcz „przekraczająca ludzkie możliwości”, która według firmy OpenAI może przynieść dobrobyt ludzkości, ma być ukoronowaniem tej swoistej technologicznej ewolucji.

Tylko że to nie do końca (albo wręcz w ogóle) tak nie wygląda. Bowiem zarówno ewolucja biologiczna, jak i ta technologiczna nie przebiegają linearnie, od stworzeń mniej rozwiniętych po „koronę stworzenia”, tj. np. ludzkość, Homo sapiens czy SI. Swoją drogą, ludzkość jest uważana za ową koronę właśnie ze względu na swój intelekt, a co do SI szans i obaw upatruje się właśnie w tym, że rzekomo miałaby zdetronizować ludzkość pod tym względem. Taka drabina ewolucyjna to historycznie (a także współcześnie) całkiem popularny pogląd, a w zasadzie mit nie tylko w okresie przeddarwinowskim. W rzeczywistości biologiczna ewolucja nie tyle przebiega po drabinie, ile bardziej przypomina dysk rozwijający się w czasie do zewnątrz, tak że występujące obecnie gatunki tworzą jego obwód. Tutaj w przeciwieństwie do „drabiny” wszystkie (żyjące) organizmy przeszły taką samą ścieżkę ewolucyjną i odniosły taki sam ewolucyjny sukces – nie da się orzec, który fragment okręgu i na jakiej podstawie miałby być „koroną stworzenia”. Zarazem takie przedstawienie unaocznia całe mnóstwo scenariuszy, na podstawie których może przebiegać ewolucja. Nie wszystkie udane, przecież są znane w biologii organizmy, które okazały się ewolucyjną ślepą uliczką, przeżyły bardzo krótko, były nieprzystosowane. Z ewolucją technologiczną jest podobnie. W historii samego XX wieku było sporo ciekawych pomysłów, które z takich czy innych powodów nie mogły się rozwinąć. By wspomnieć chilijski projekt Cybersyn – oryginalny autorski pomysł własnego internetu, rozwijany w latach 1971-1973, brutalnie zakończony wraz z zamachem stanu. Albo rodzącą się w połowie XX wieku cybernetykę, niekiedy z radykalnie odmiennym poglądem na rolę komputerów, człowieczeństwa czy środowiska. Niektórzy cybernetycy nie chcieli ograniczać roli upowszechniających się do komputerów tylko do obliczeń, predykcji czy automatyzacji pracy – w ich wizji technologia mogła znacząco poszerzać nasze horyzonty, aniżeli tylko biernie podsuwać nam nowe produkty do konsumpcji tudzież ewentualnie sama takie wytwarzać. Nic się z tego nie ziściło, gdyż cybernetyka przegrała swoisty ewolucyjny wyścig z powstającą sztuczną inteligencją (która – co ciekawe – sama później podchwyciła wiele pomysłów cybernetycznych).

Na rozwój mamy wpływ

W przeciwieństwie do ślepej ewolucji biologicznej, będącej niczym majster-klepka operujący w myśl dewizy „Jak działa, to nie poprawiaj”, rozwój technologii zależy przede wszystkim od ludzi, skądinąd niekiedy też zaślepionych. O ironio, rozwój ten nie jest sam w sobie automatyczny czy mechaniczny – nic tu się samo nie zrobi – jest za to wypadkowa wielu czynników, tyleż technologicznych co społecznych czy politycznych. Rewolucja przemysłowa przyniosła fabryki, a w nich pracujące dzieci i ogólnie fatalne warunki pracy. Zarazem w pierwszych latach rewolucji bogacili się głównie przemysłowcy, rosły nierówności ekonomiczne. Taki stan rzeczy zapoczątkował początek walki o coś, co dzisiaj nazywamy prawami pracowniczymi, BHP czy związkami zawodowymi. Ze sztuczną inteligencją może być (i niekiedy jest) podobnie. Za rozwojem technologii cyfrowych i SI stoi konglomerat gigantycznych firm, który używa swoich produktów technologicznych głównie, by generować zyski i cementować swoją hegemoniczną pozycję. Mimo że na rozwój SI tak na dobrą sprawę pracujemy wszyscy, dostarczając codziennie dane w internecie (a także armia kiepsko opłacanych pracowników Globalnego Południa), to podobnie jak działo się to w XIX-wiecznej Anglii, zyski czerpie wąski oligopol firm technologicznych nieprzejmujący się np. zalewem fake newsów, deep fake’ów czy erozją procesów demokratycznych. Tak jak w XIX wieku rośnie też opór przeciwko uwłaszczaniu się technologicznych gigantów na coraz to nowych obszarach rzeczywistości – by wspomnieć zeszłoroczny strajk scenarzystów czy aktorów w USA przeciwko SI czy platformom streamingowym, a także niedawny (acz nieco niemrawy) protest w obronie mediów w Polsce. Choć ludzie przecież nie są maszynami, to w starciu z nieludzką technologią mogą siłą rzeczy być redukowani do czegoś na wzór maszyn – tylko mniej wydajnych – takich, które łatwo zastąpić innymi, lepszymi. A przecież nie ma nic zdrożnego w dążeniu do automatyzacji pracy – jest to efekt pewnego względnie świeżego konsensusu technologiczno-biznesowego, którego efektem są znane dziś technologie. Człowiek może wpływać na ewolucję biologiczną, np. wybijając jedne gatunki, a inne krzyżując z sobą niekiedy na cele masowych hodowli. Analogicznie ludzkość może wpływać na rozwój technologii (może już mniej drastycznymi metodami), która faktycznie może być narzędziem demokratycznym i demokratyzującym albo – jak chcieli cybernetycy – poszerzającym nasze horyzonty w nieoczywisty sposób. Nie będzie to możliwe, jeśli wszystkie ważne decyzje będzie podejmować wąska grupka techno- logicznych liderów buńczucznie przeświadczonych o swojej misji dziejowej przynoszenia dobrobytu dla całej ludzkości.

Choć ludzie przecież nie są maszynami, to w starciu z nieludzką technologią mogą siłą rzeczy być redukowani do czegoś na ich wzór.

Same te firmy, choć już teraz gargantuiczne i rekordowo wyceniane, ciągle myślą o dalszej ekspansji. Zarazem ich ślad węglowy, a w szczególności generatywnej SI, jest ogromny (choć zarazem trudny do dokładnego oszacowania). A przecież już teraz dochodzimy do planetarnych granic takiej eksploatacji, nie można przecież bez konsekwencji rosnąć bez opamiętania. Problemy te były nieznane u progu rewolucji przemysłowej, która dopiero zapoczątkowywała na globalną skalę procesy zarówno wydobywania (i spalania) paliw kopalnych, jak i procesy automatyzacji pracy. „Kwestia maszyn” wciąż, a może właśnie w końcu, czeka na swoje rozwiązanie. Jeśli nie teraz, to kiedy? Inna przyszłość jest (jeszcze) możliwa.

Chcesz wiedzieć więcej?

Acemoglu D., Johnson S., Power and progress: our thousand-year struggle over technology and prosperity, 2023.

Dundon T., Howcroft D., Automation, robots and the ‘end of work’ myth, 2018, theconversation.com/ automation-robots-and-the- end-of-work-myth-89619 Kelly K.,

The Myth of a Superhuman AI, 2017, www.wired.com/2017/04/the- myth-of-a-superhuman-ai/