AI zmienia to, jak tworzymy i jak rozumiemy prawdę

Generatywna sztuczna inteligencja, która tworzy treści na podstawie poleceń użytkownika, zmienia to, jak ludzie tworzą, edytują i prezentują tekst i obrazy. Innymi słowy, zmienia to, jak widzimy i jak decydujemy, co jest prawdziwe

Od pierwszych lat nauki dzieci uczą się na różne sposoby wyrażać pomysły. Linie na stronie, chwiejna litera czy prosty rysunek tworzą fundament tego, jak dzielimy się znaczeniami poza językiem mówionym. Z czasem te pierwsze znaki przekształcają się w złożone idee. Dzieci uczą się łączyć słowa z obrazami, wyrażać pojęcia abstrakcyjne i rozumieć, jak obrazy, symbole czy projekt niosą znaczenie w różnych kontekstach.

Generatywna sztuczna inteligencja przekształca jednak te podstawowe umiejętności. Weźmy na przykład fotografie. Kiedyś postrzegano je jako „lustro” rzeczywistości. Dziś coraz więcej ludzi dostrzega ich konstruowany charakter. Podobnie generatywna AI podważa długo utrzymywane założenia dotyczące autentyczności obrazów. Mogą wyglądać fotorealistycznie, a jednak przedstawiać rzeczy lub wydarzenia, które nigdy nie istniały.

Nasze najnowsze badania, opublikowane w Journal of Visual Literacy, identyfikują kluczowe kompetencje na każdym etapie procesu generowania obrazów przez AI – od wyboru generatora po tworzenie i dopracowywanie treści. W miarę jak zmienia się sposób tworzenia obrazów, wiedza o tym, jak działa generatywna AI, pozwoli lepiej rozumieć i krytycznie oceniać rezultaty, jakie daje.

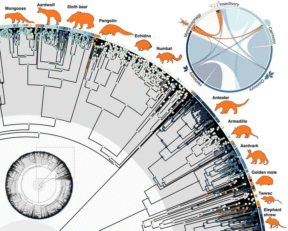

Źródło: Wikimedia Commons / CC BY-NC 4.0

Piśmienność tekstowa i wizualna

Współczesna piśmienność wykracza daleko poza umiejętność czytania i pisania. Australijski program nauczania definiuje ją jako zdolność „pewnego posługiwania się językiem do uczenia się i komunikowania w szkole i poza nią”. Unia Europejska rozszerza to pojęcie o kompetencje w zakresie poruszania się po materiałach wizualnych, dźwiękowych i cyfrowych. To umiejętności niezbędne nie tylko w edukacji, lecz także dla aktywnego obywatelstwa.

Kompetencje te obejmują nadawanie sensu, komunikowanie się i tworzenie za pomocą słów, obrazów i innych form przekazu, a także dostosowywanie stylu do odbiorców. Można na przykład napisać do przyjaciela nieformalną wiadomość, a do urzędnika – list bardziej oficjalny. Komputery również wymagają odmiennej formy piśmienności.

W latach 60. użytkownicy komunikowali się z komputerami za pomocą poleceń tekstowych. W latach 70. pojawiły się elementy graficzne – ikony i menu – które uczyniły interakcję bardziej wizualną. Generatywna AI często łączy obie te drogi. Niektóre technologie, jak ChatGPT, opierają się głównie na poleceniach tekstowych. Inne, jak Firefly firmy Adobe, łączą polecenia tekstowe z graficznymi suwakami i przyciskami.

Oprogramowanie często interpretuje lub odgaduje intencje użytkownika – zwłaszcza przy minimalistycznych poleceniach, takich jak pojedyncze słowo czy emoji. W takich przypadkach AI zwykle generuje stereotypowe przedstawienia wynikające z danych treningowych lub sposobu zaprogramowania systemu.Im precyzyjniejsze polecenie, tym bardziej zbliżony do zamierzonego efekt. To pokazuje, że potrzebne są tzw. piśmienności multimodalne – wiedza i umiejętności obejmujące zarówno tekst, jak i obrazy.

Kluczowe kompetencje w generowaniu przez AI

Jedną z pierwszych kompetencji jest umiejętność wyboru odpowiedniego systemu. Niektóre są darmowe, inne płatne; część korzysta z danych o niejasnym lub nieetycznym pochodzeniu. Niektóre modele uczono na określonych zbiorach danych, co sprawia, że ich wyniki są bardziej reprezentatywne – lub mniej ryzykowne z punktu widzenia praw autorskich. Jedne wspierają różnorodne dane wejściowe (obrazy, dokumenty, arkusze kalkulacyjne), inne działają wyłącznie na tekście.

Po wybraniu generatora obrazów trzeba umieć z niego korzystać efektywnie. Jeśli chcesz stworzyć obraz kwadratowy do posta na Instagramie – masz szczęście, bo wiele systemów AI generuje taki format domyślnie. Jeśli jednak potrzebujesz obrazu poziomego lub pionowego, musisz o to poprosić lub samodzielnie zmienić ustawienia.

A co, jeśli chcesz, by w obrazie znalazł się tekst? AI wciąż ma z tym trudności, podobnie jak wczesne systemy sztucznej inteligencji miały kłopot z wiernym odwzorowaniem ludzkich palców i uszu. W takich przypadkach lepiej dodać tekst w innym oprogramowaniu, na przykład w Canvie lub Adobe InDesign.

Wiele systemów AI tworzy też obrazy pozbawione wyraźnego kontekstu kulturowego, co ułatwia ich uniwersalne wykorzystanie, ale może osłabiać emocjonalny odbiór u widzów, którzy uznają je za nieautentyczne.

Praca z AI to ruchomy cel

Uczenie się pracy z AI oznacza ciągłe dostosowywanie się do zmian. Regularnie pojawiają się nowe narzędzia generatywne, a istniejące szybko się rozwijają. Na początku tego roku OpenAI zintegrowało generowanie obrazów z ChatGPT, TikTok uruchomił narzędzie AI Alive do animowania zdjęć, Google Veo 3 udostępnił w Canvie funkcję tworzenia filmów z dźwiękiem, a Midjourney – generowanie wideo.

Takie przykłady pokazują kierunek rozwoju: użytkownicy będą mogli tworzyć i edytować tekst, obraz, dźwięk i wideo w jednym środowisku, zamiast korzystać z oddzielnych programów. Budowanie piśmienności multimodalnych oznacza rozwijanie umiejętności adaptacji, oceny i współtworzenia treści w miarę ewolucji technologii.

Jeśli chcesz zacząć już teraz, zadaj sobie kilka prostych pytań:

Co chcę, aby moi odbiory zobaczyli albo zrozumieli?

Czy powinienem użyć AI do stworzenia tej treści?

Co dokładnie generuje narzędzie AI i jak mogę wpłynąć na wynik?

Podejście do wizualnej generatywnej AI z ciekawością, ale i krytycznym myśleniem, to pierwszy krok do świadomego, skutecznego korzystania z tych technologii. Dzięki temu możemy tworzyć historie wizualne niosące wartości ludzkie, nie maszynowe.

Autorzy:

T.J. Thomson, starszy wykładowca komunikacji wizualnej i mediów cyfrowych, RMIT University

Daniel Pfurtscheller, asystent profesora, lingwistyka medialna, University of Innsbruck

Katharina Christ, starsza badaczka, studia nad mediami, National Institute for Science Communication

Katharina Lobinger, profesor komunikacji internetowej i wizualnej, Università della Svizzera italiana

Nataliia Laba, adiunkt w zakresie komunikacji cyfrowej i multimodalnej oraz Humane AI, University of Groningen

Artykuł ukazał się pierwotnie w serwisie The Conversation

Polecane:

-

Artykuł

„Czołgający się pionier” sprzed 400 mln lat zmienia historię wyjścia kręgowców na ląd Przejdź do publikacji: „Czołgający się pionier” sprzed 400 mln lat zmienia historię wyjścia kręgowców na ląd

-

Badaczka, która na nowo zdefiniowała znaczenie bycia człowiekiem Przejdź do publikacji: Badaczka, która na nowo zdefiniowała znaczenie bycia człowiekiem

-

Artykuł

Autyzm jako koszt ewolucji? Przejdź do publikacji: Autyzm jako koszt ewolucji?

Podobne artykuły

Przejdź do publikacji: AI proponuje nowe terapie na raka

Przejdź do publikacji: AI proponuje nowe terapie na raka

AI proponuje nowe terapie na raka Przejdź do publikacji: AI proponuje nowe terapie na raka

Przejdź do publikacji: Jak sztuczna inteligencja wzmacnia miękką propagandę

Przejdź do publikacji: Jak sztuczna inteligencja wzmacnia miękką propagandę

Jak sztuczna inteligencja wzmacnia miękką propagandę Przejdź do publikacji: Jak sztuczna inteligencja wzmacnia miękką propagandę

Przejdź do publikacji: Czy Polska traci swoją szansę w IT?

Przejdź do publikacji: Czy Polska traci swoją szansę w IT?