Sekwencje liczb odkryte przez matematyków rosną tak szybko, że klasyczny przykład z ziarnami ryżu na szachownicy wygląda przy nich jak proste ćwiczenie szkolne. Problem nie polega wyłącznie na skali tych liczb. Badania nad nimi doprowadziły matematyków do niewygodnego wniosku: istnieją twierdzenia o zwykłych liczbach naturalnych, których nie da się udowodnić przy użyciu standardowych reguł arytmetyki

Legenda o wynalazcy szachów od dawna służy jako przykład potęgi wzrostu wykładniczego. Według opowieści twórca gry poprosił władcę o pozornie skromną nagrodę: jedno ziarno ryżu na pierwszym polu szachownicy, dwa na drugim, cztery na trzecim i tak dalej, za każdym razem podwajając liczbę ziaren. Gdy zsumować wszystkie 64 pola, wynik okazuje się astronomiczny. Dla współczesnych matematyków to jednak dopiero rozgrzewka.

Badacze zajmujący się logiką matematyczną opisali procesy generujące liczby tak ogromne, że samo pojęcie „bardzo dużej liczby” przestaje mieć praktyczne znaczenie. Niektóre z tych sekwencji rosną szybciej niż niemal wszystko znane wcześniej w matematyce.

Od prostych reguł do problemów z fundamentami matematyki

Matematycy od tysięcy lat operowali liczbami wykraczającymi daleko poza codzienne doświadczenie. Babilończycy wykonywali obliczenia większe niż liczba atomów Ziemi, Archimedes próbował oszacować liczbę ziaren piasku potrzebnych do wypełnienia Wszechświata, a klasyczni Majowie rozważali przedziały czasu liczone w oktylionach lat.

W XIX w. włoski matematyk Giuseppe Peano próbował uporządkować podstawy arytmetyki. Zaproponował zestaw prostych aksjomatów opisujących liczby naturalne: po 0 następuje 1, po 1 następuje 2 i tak dalej. Z tych reguł można zbudować dodawanie, mnożenie i dzielenie. Przez długi czas wydawało się, że taki zestaw zasad wystarcza do całej „zwykłej” matematyki.

Sytuację zmienił Kurt Gödel. W 1931 r. pokazał, że żaden system aksjomatów nie jest w stanie objąć wszystkich prawdziwych twierdzeń o liczbach. Istnieją zdania matematyczne prawdziwe, ale niemożliwe do udowodnienia w ramach danego systemu. Początkowo wyglądało to bardziej na problem filozoficzny niż praktyczny.

Sekwencja Goodsteina wymyka się intuicji

W latach 40. brytyjski matematyk Reuben Goodstein zaproponował matematyczną zabawę z liczbami. Reguły wyglądały banalnie, ale prowadziły do bardzo nieintuicyjnych rezultatów.

Załóżmy, że zaczynamy od liczby 4. Najpierw zapisujemy ją w systemie dwójkowym, czyli takim, którego używają komputery. W tym zapisie 4 ma postać 2 do potęgi 2. Następnie wykonujemy dwa kroki. Najpierw zamieniamy wszystkie dwójki na trójki. Liczba zmienia się więc z „2 do potęgi 2” w „3 do potęgi 3”, czyli 27. Potem odejmujemy 1 i otrzymujemy 26.

Kolejny krok nie polega na mechanicznym dopisaniu większej liczby. Najpierw trzeba zapisać 26 w systemie trójkowym, czyli przy użyciu potęg liczby 3. Dopiero potem zamieniamy wszystkie trójki na czwórki i znów odejmujemy 1. W następnym kroku postępujemy analogicznie: zapisujemy wynik w systemie czwórkowym, zamieniamy czwórki na piątki i ponownie odejmujemy 1.

Na początku wygląda to jak przepis na nieskończony wzrost. Liczby eksplodują niemal natychmiast. Dla większych wartości stają się tak ogromne, że przestają mieścić się w standardowym zapisie. A jednak dzieje się coś zupełnie nieintuicyjnego: po odpowiednio dużej liczbie kroków sekwencja zaczyna maleć i ostatecznie zawsze dochodzą do zera.

W 1982 r. Jeff Paris i Laurie Kirby pokazali, że twierdzenia Goodsteina nie da się udowodnić przy użyciu klasycznych aksjomatów Peano. Był to pierwszy konkretny przykład ograniczeń przewidzianych wcześniej przez Gödla.

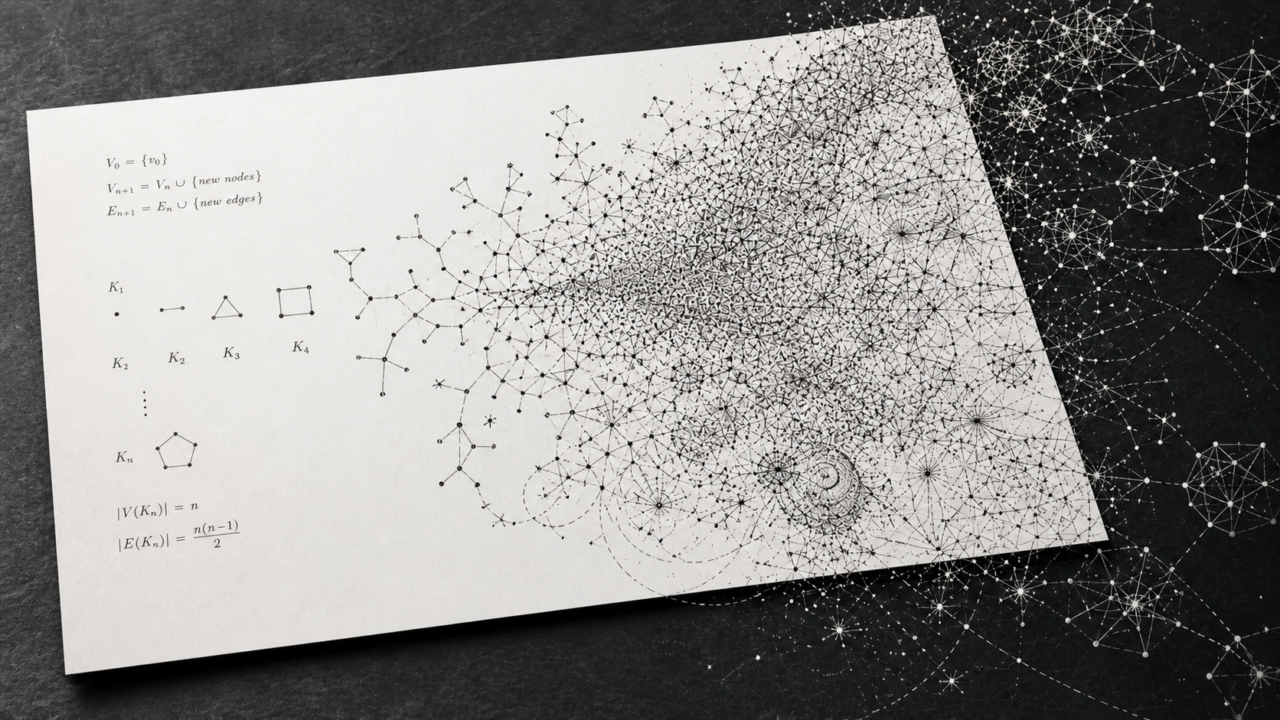

Grafy prowadzą jeszcze dalej

Jeszcze dalej prowadzą badania nad teorią grafów, czyli matematycznych struktur złożonych z punktów i połączeń między nimi. W ten sposób opisuje się między innymi internet, sieci energetyczne czy relacje między cząsteczkami chemicznymi.

W latach 80. i 90. matematycy Neil Robertson i Paul Seymour udowodnili słynne twierdzenie o minorach grafów. Pokazuje ono, że w odpowiednio dużej kolekcji grafów wcześniej czy później jeden z nich będzie zawarty w innym. To jeden z najważniejszych wyników współczesnej teorii grafów. Problem polega na tym, że pełny dowód wymaga logiki wykraczającej poza standardową arytmetykę.

Późniejsze prace Harveya Friedmana pokazały, że związane z tym twierdzeniem sekwencje liczb rosną szybciej niż niemal wszystko znane wcześniej w matematyce. Jedną z takich konstrukcji jest tzw. sekwencja subkubicznych grafów, oznaczana jako SCG. Nawet jej wczesne elementy okazują się większe niż ogromne liczby pojawiające się w ciągach Goodsteina.

Gdzie kończy się intuicja

Najbardziej zaskakujące w całej tej historii jest to, że dotyczy ona zwykłych liczb naturalnych, punktów i linii. Nie egzotycznej fizyki ani abstrakcyjnych wielowymiarowych przestrzeni. A jednak nawet tak podstawowe konstrukcje prowadzą do pytań, których klasyczna matematyka nie potrafi już rozstrzygnąć własnymi narzędziami.

Nie jest to wyłącznie filozoficzna ciekawostka. Badania nad takimi strukturami mają bezpośredni związek z informatyką teoretyczną, teorią algorytmów i analizą złożonych sieci. Twierdzenie o minorach grafów stało się jednym z fundamentów współczesnej teorii grafów, wykorzystywanej między innymi przy analizie internetu, sieci energetycznych, infrastruktury transportowej czy projektowaniu układów scalonych.

Prace nad granicami dowodliwości pomagają również zrozumieć, jakie problemy mogą zostać rozwiązane algorytmicznie, a które są zbyt złożone dla określonych klas metod matematycznych i komputerowych. To jeden z powodów, dla których logika matematyczna stała się ważna także dla rozwoju informatyki.

Sekwencje Goodsteina i podobne konstrukcje pokazują przy tym coś jeszcze: nawet bardzo proste reguły mogą prowadzić do zachowań, których nie umiemy intuicyjnie przewidzieć. A właśnie takie sytuacje coraz częściej pojawiają się dziś w systemach komputerowych, dużych sieciach i modelach AI, gdzie proste lokalne zasady potrafią generować zaskakująco złożone efekty.

Źródło:

Richard Elwes, „The monstrous number sequences that break the rules of mathematics”, New Scientist, 21 kwietnia 2026.

Polecane:

-

Jak rośnie ludzkość? Uniwersalny wzór i równanie Verhulsta a historia populacji świata Przejdź do publikacji: Jak rośnie ludzkość? Uniwersalny wzór i równanie Verhulsta a historia populacji świata

-

Artykuł

Nagrody dla 228 młodych naukowców. Znamy listę stypendystów Przejdź do publikacji: Nagrody dla 228 młodych naukowców. Znamy listę stypendystów

-

Wideo

Od atmosfery do księgowości: niespodziewane powiązania fizyki chmur – A co PAN radzi? #16 Przejdź do publikacji: Od atmosfery do księgowości: niespodziewane powiązania fizyki chmur - A co PAN radzi? #16

Podobne artykuły

Przejdź do publikacji: Co pozostało do odkrycia w matematyce? Prof. Kołodziej laureatem Medalu im. Banacha

Przejdź do publikacji: Co pozostało do odkrycia w matematyce? Prof. Kołodziej laureatem Medalu im. Banacha

Co pozostało do odkrycia w matematyce? Prof. Kołodziej laureatem Medalu im. Banacha Przejdź do publikacji: Co pozostało do odkrycia w matematyce? Prof. Kołodziej laureatem Medalu im. Banacha

Przejdź do publikacji: Fizycy, łobuzy, geniusze. Rozmowa z prof. Andrzejem Kajetanem Wróblewskim

Przejdź do publikacji: Fizycy, łobuzy, geniusze. Rozmowa z prof. Andrzejem Kajetanem Wróblewskim

Fizycy, łobuzy, geniusze. Rozmowa z prof. Andrzejem Kajetanem Wróblewskim Przejdź do publikacji: Fizycy, łobuzy, geniusze. Rozmowa z prof. Andrzejem Kajetanem Wróblewskim

Przejdź do publikacji: Sztuka patrzenia na cienie. O badaniach dr. Damiana Dąbrowskiego

Przejdź do publikacji: Sztuka patrzenia na cienie. O badaniach dr. Damiana Dąbrowskiego